So wie vermutlich einige, bin auch ich zur Zeit sehr von GitLab und dessen CI/CD Features angetan. Vor einigen Monaten habe ich angefangen, für meine privaten Webprojekte eine Template .gitlab-ci.yml zu erstellen, welche für jeden Commit, auf jedem Branch, automatisch Docker Images baut und diese in meiner Docker-Umgebung mit zum Branch/Projekt passender Subdomain und SSL-Zertifikat bereitstellt.

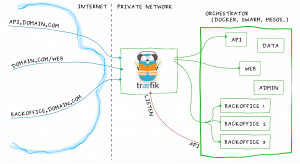

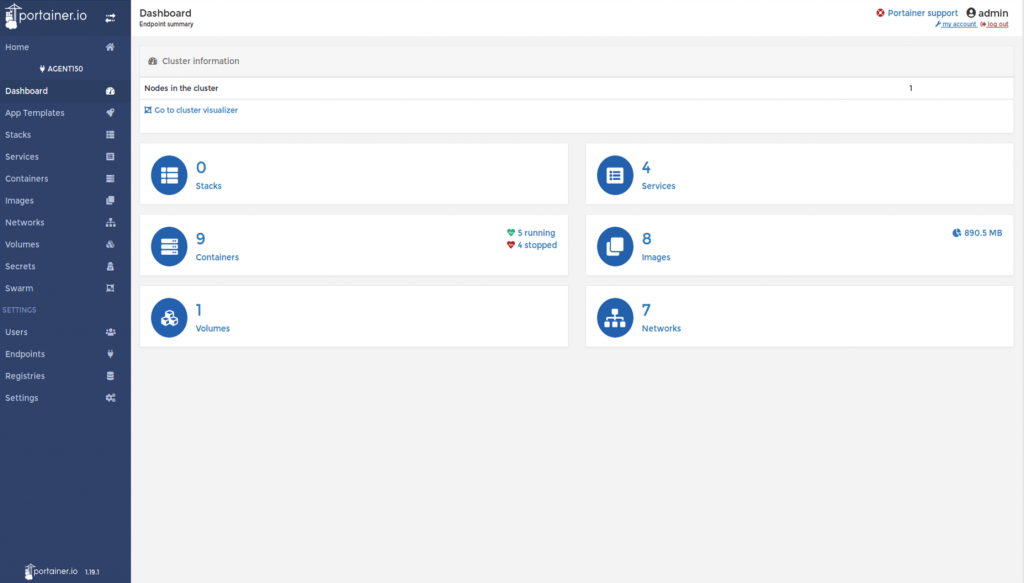

Um zu funktionieren benötigt das ganze eine erreichbare Docker-API, ein darauf laufendes Traefik, ein Docker-Netzwerk namens Proxy (Traefik muss dieses auch nutzen) und einen Account + Repository auf hub.docker.com. Das ganze kann aber recht einfach umgeschrieben werden, falls man seine eigene Registry verwenden möchte.

Ablauf beim Commit:

- Bauen und Pushes des Images (Tag => Branch + Commit-Hash)

- Umbenennen des alten Containers, falls vorhanden (Suffix ‚-old‘ wird angehangen)

- Erstellen des neuen Containers (Name => Deployment Domain bsp. master.dev.domain.tld)

- Löschen des alten Containers

- (Optional) Löschen & neu erstellen des Produktionscontainers, falls der Commit auf dem Masterbranch stattgefunden hat (Muss durch Button ausgelöst werden und läuft wie Schritte 2 bis 4 ab)

- Neue Container stehen unter den Deployment-Domains zur Verfügung

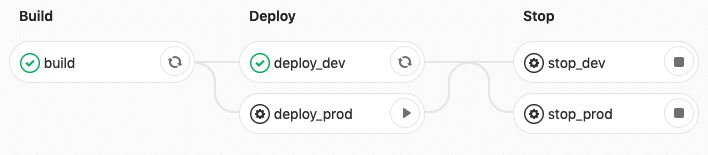

Pipeline eines Commits auf Master/andere Branches (Deploy auf Produktion kann durch „Play“-Button ausgelöst werden):

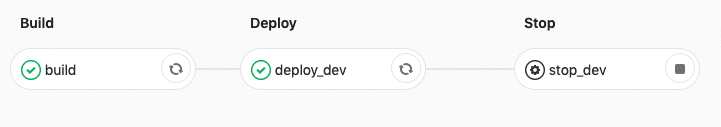

Pipeline eines Commits auf andere Branches:

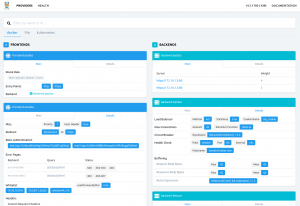

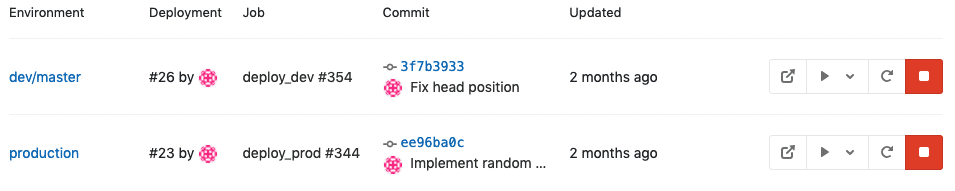

Für jeden Branch wird auch ein Environment erstellt, welches über Operations/Environments in GitLab verwaltet werden kann.

Hier können Deployments angesehen, gelöscht, in Produktion ausgerollt und auf einen früheren Stand zurückgesetzt werden:

Zur Nutzung des Templates in einem Projekt wird ein Dockerfile im Repository, ein paar CI/CD-Variablen, und das Template selber benötigt.

Benötigte CI/CD-Variablen:

CI_DEV_URL_SUFFIX (Domain-Suffix der Development-Umgebungen): dev.domain.tld

CI_PRODUCTION_URL (Domain der Produktionsumgeben): domain.tld

CI_DOCKER_HOST (Adresse & Port der Docker-API): docker.domain.tld

CI_REGISTRY_IMAGE (Image-Name auf hub.docker.com): supertolleruser/supertollesoftware

CI_REGISTRY_USER (Docker-Hub Benutzer): supertolleruser

CI_REGISTRY_PASSWORD (Passwort des Docker-Hub Benutzers): supertollespasswort

CI_TRAEFIK_PORT (Port der Webanwendung im Container): 8080

Da das ganze Projekt bis jetzt nur Images baut und Container bereitstellt, könnten hier natürlich noch Tests eingebaut werden um das ganze abzurunden.

Zur Zeit arbeite ich an einer Umstellung auf Kubernetes und werde, sobald abgeschlossen, auch davon berichten.

Egal ob

Egal ob