Willkommen beim NETWAYS GitHub Update, unser monatlicher Überblick über unsere neuesten Releases.

Im Juli 2023 haben wir wieder einen ganzen Schwung spannender Updates an den Start gebracht. Dazu gehören unter anderem eine Aktualisierung der Golang Bibliothek für Check-Plugins, Version 1.2.5 unseres beliebten Icinga Installers sowie ein neuer Release des NETWAYS Support Collectors.

Zudem haben die Check-Plugins für Bareos, Elasticsearch und Logstash einige Änderungen spendiert bekommen!

Wenn du in Zukunft Updates direkt zu Release erhalten willst, folge uns einfach auf GitHub: https://github.com/NETWAYS/

check-bareos Release v2.0.0

Wir haben diesen Monat einen großen Refactor des Check Plugins durch, damit werden wir das Tool in Zukunft besser warten können. Gibt viele Änderungen, am besten die Release Notes lesen.

Changelog

- Hinzugefügt: Viele neue Unittests!

- Hinzugefügt: CLI Parameter unterstützen Thresholds

- Ausgabe normalisiert und erweitert

- Diverse Bugfixes

https://github.com/NETWAYS/check_bareos/releases/tag/v2.0.0

go-check Release v0.5.0

Ein etwas größeres Release unserer Golang Bibliothek für Check Plugins. Mit diesem Release haben wir einiges an Code aufgeräumt.

Changelog

- Einige Abhängigkeiten entfernt

- Breaking Change: metric und benchmark Pakete entfernt

- Breaking Change: http/mock Paket entfernt

- Breaking Change: Ältere Funktionen entfernt

- Bugfix: Fehler in der Ausgabe von PartialResult gefixt

- Viele kleine Fixes unter der Haube

https://github.com/NETWAYS/go-check/releases/tag/v0.5.0

check-elasticsearch Release v0.3.0

Changelog

- Hinzugefügt: Neuer Subcheck für Ingest Pipelines

- Refactor um teilweise kompatibel mit OpenSearch zu sein

- Viele Optimierungen unter der Haube

https://github.com/NETWAYS/check_elasticsearch/releases/tag/v0.3.0

check-logstash Release v0.9.0

Changelog

- Hinzugefügt: Neuer Subcheck für Logstash 8 Pipeline Metriken

- Hinzugefügt: Neuer Subcheck für Logstash Pipeline Reload Fehler

https://github.com/NETWAYS/check_logstash/releases/tag/v0.9.0

support-collector Release v0.9.0

Changelog

- Hinzugefügt: Viele neue Kollektoren (Elastic Stack, Prometheus, Graylog, MongoDB, Foreman, diverse Webserver)

- Hinzugefügt: Neue CLI Option um sensitive Daten zu entfernen

- Hinzugefügt: Das Tool sammelt jetzt auch teilweise Logdateien ein

- Viele Abhängigkeiten unter der Haube aktualisiert

https://github.com/NETWAYS/support-collector/releases/tag/v0.9.0

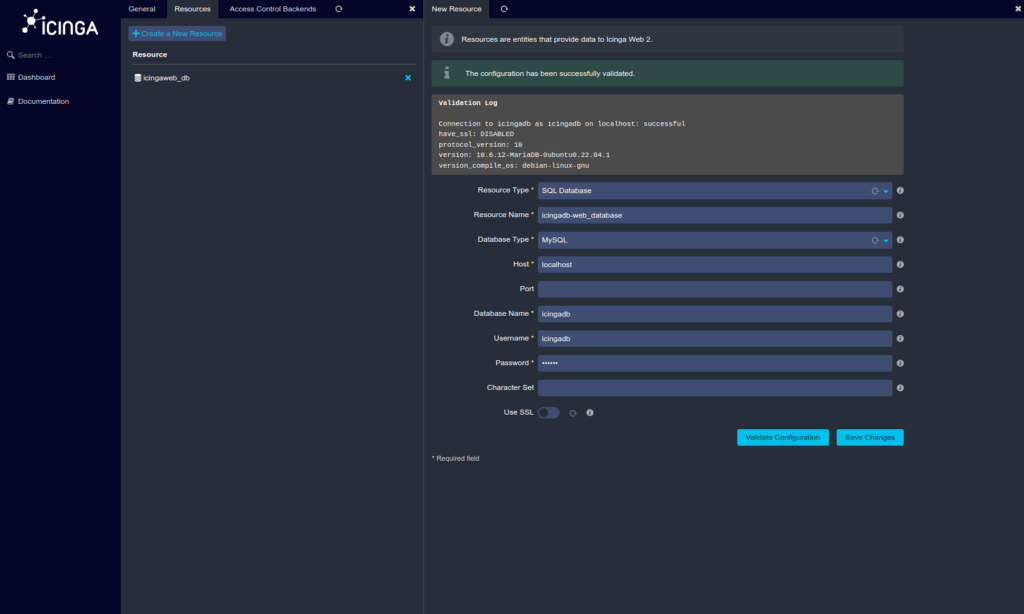

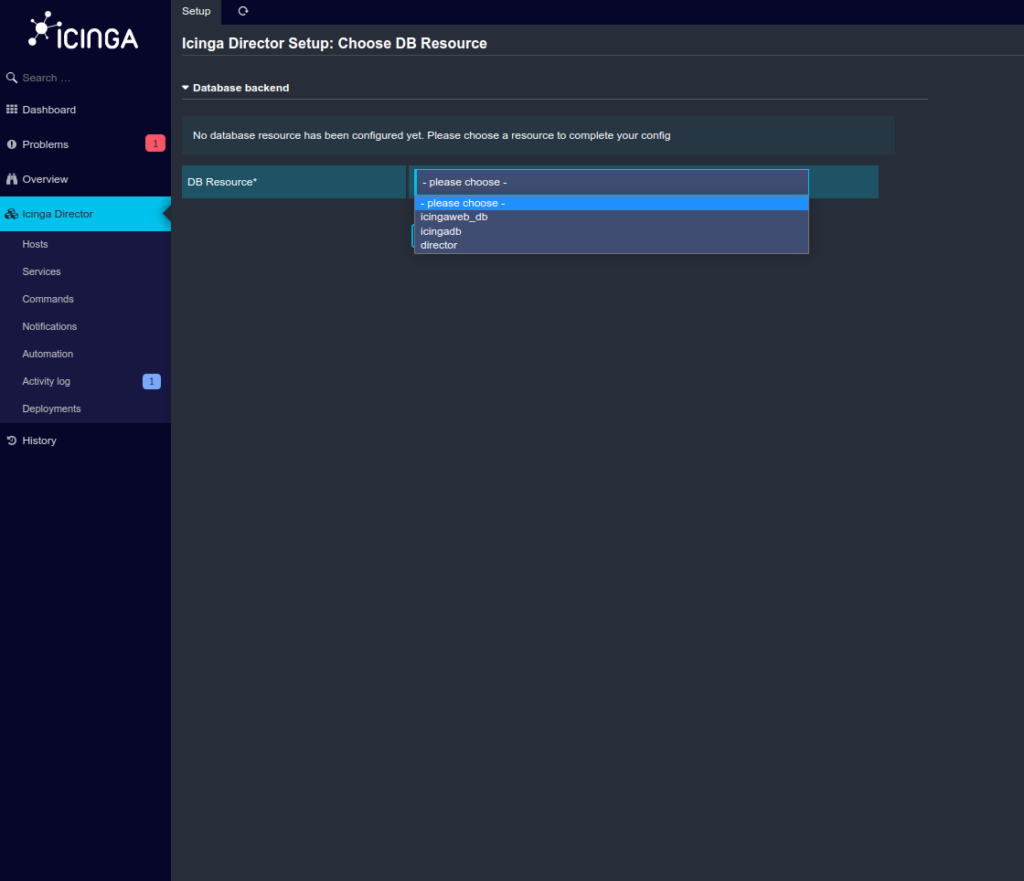

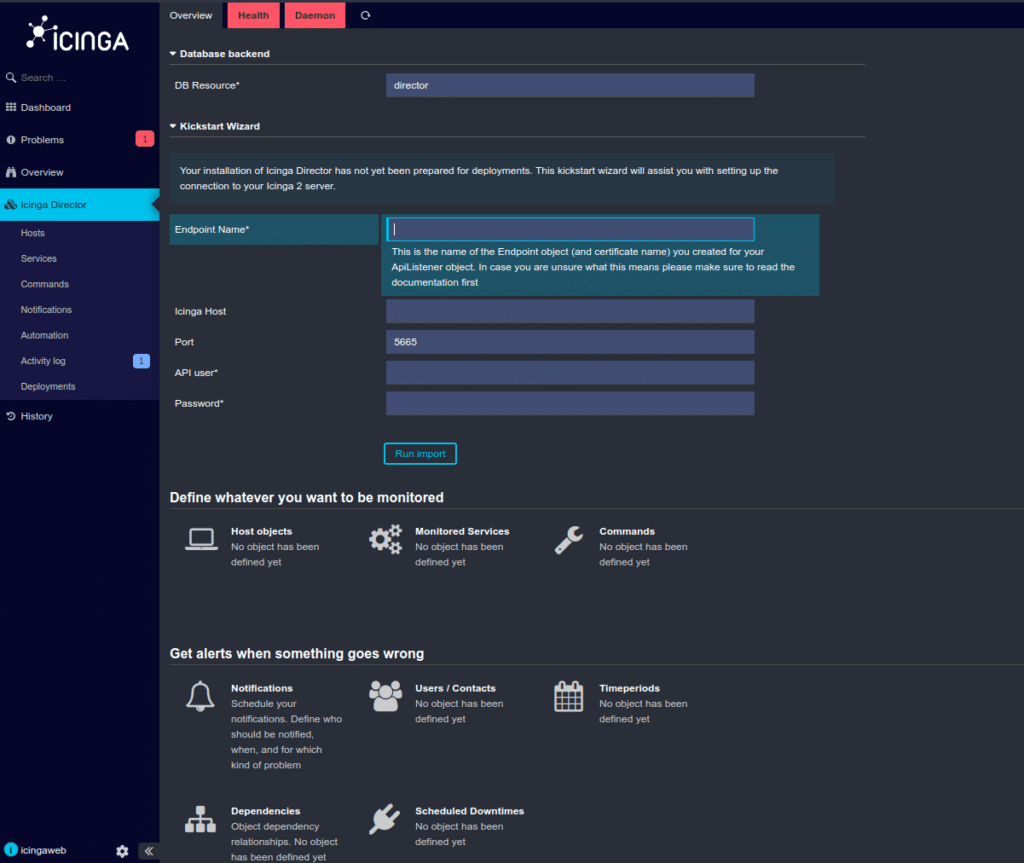

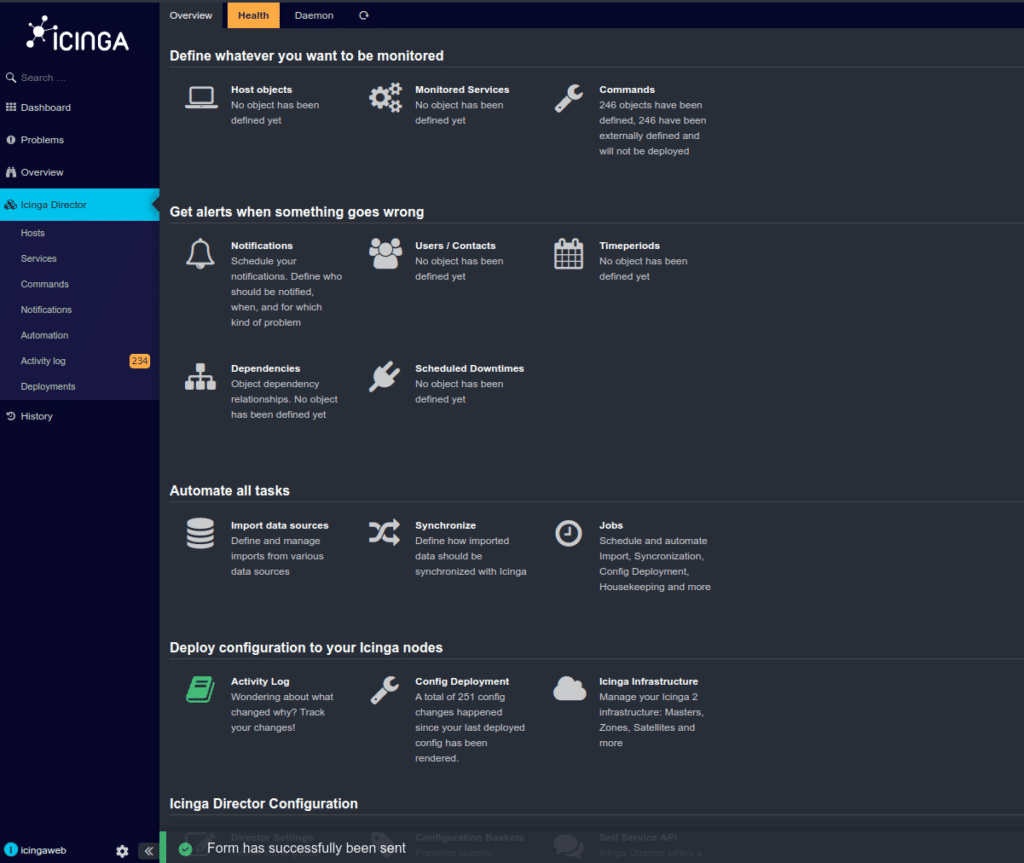

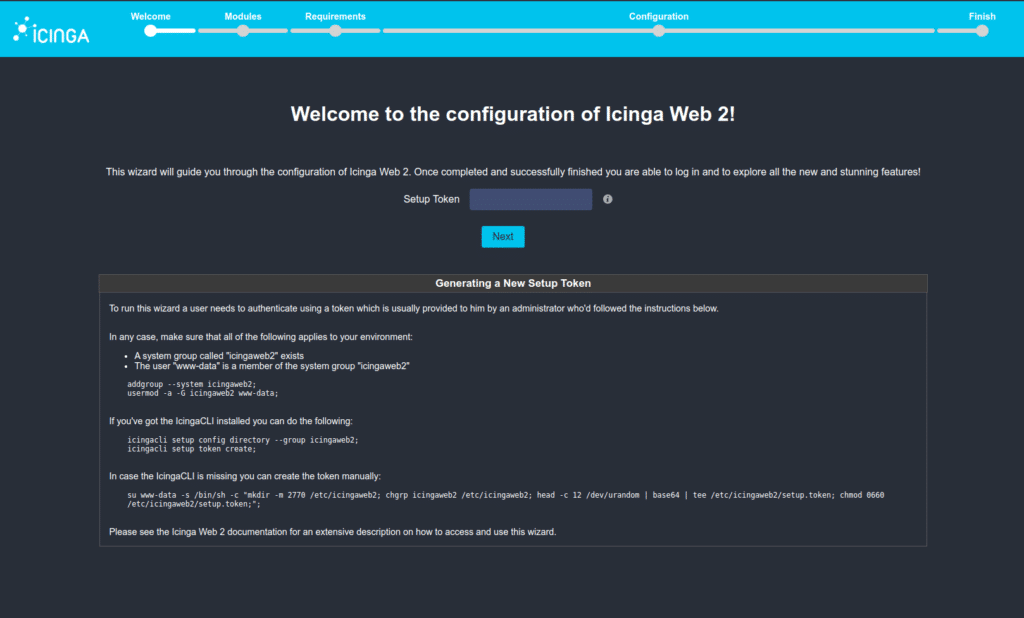

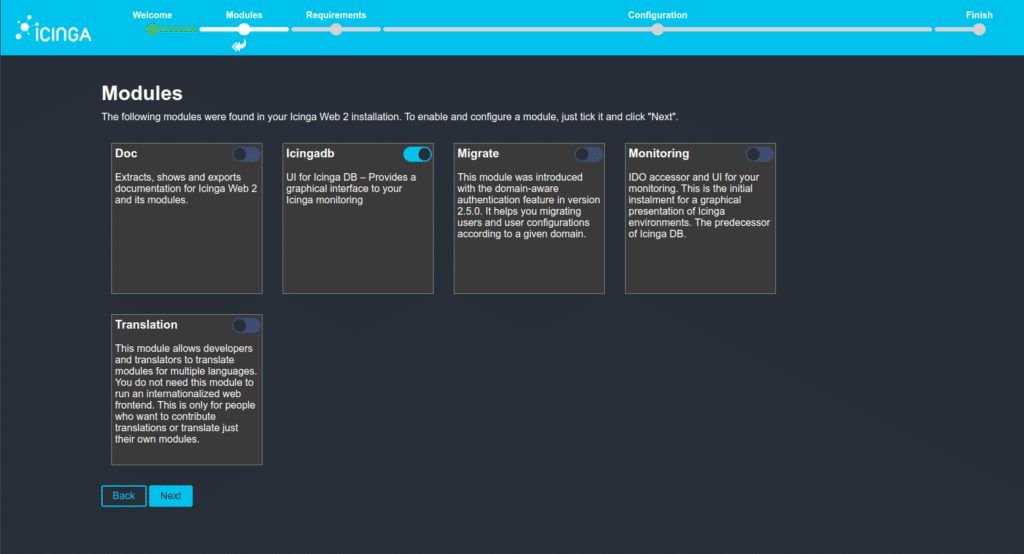

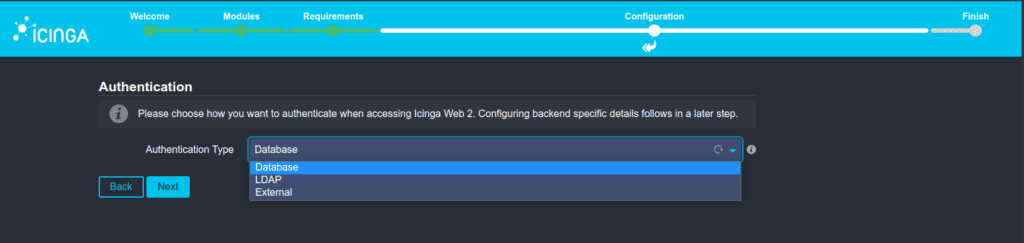

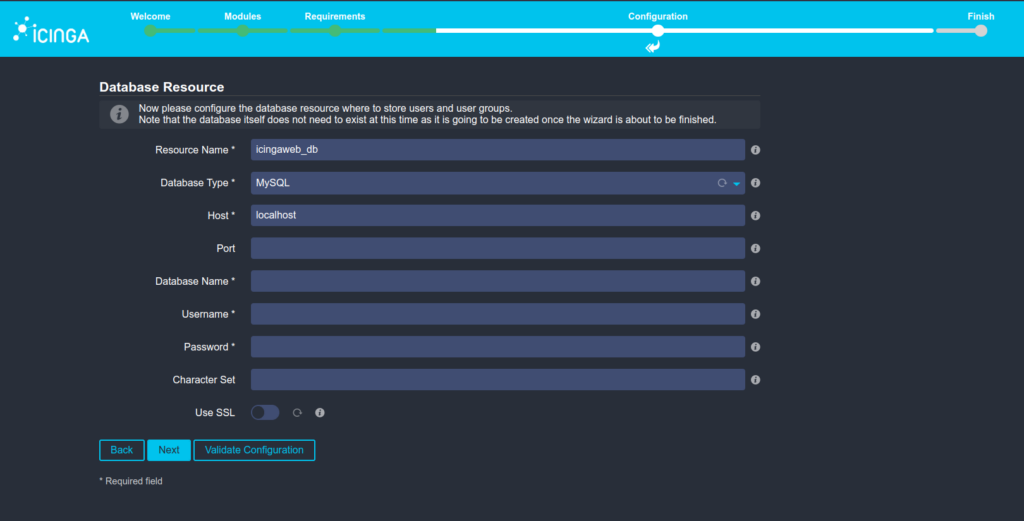

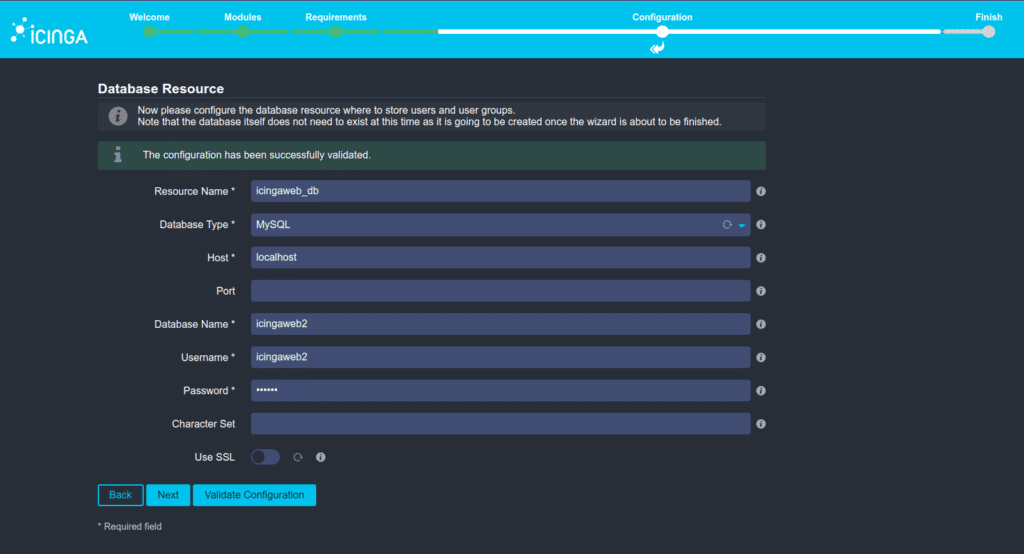

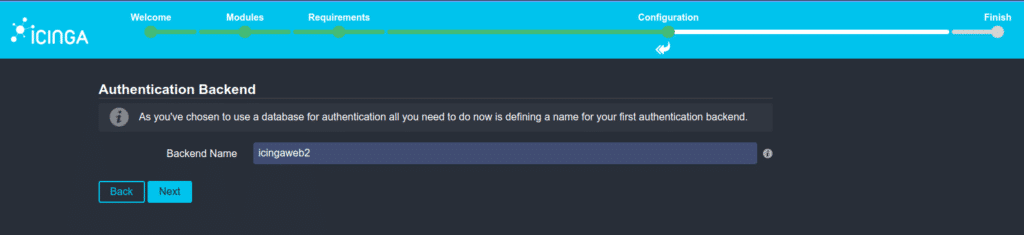

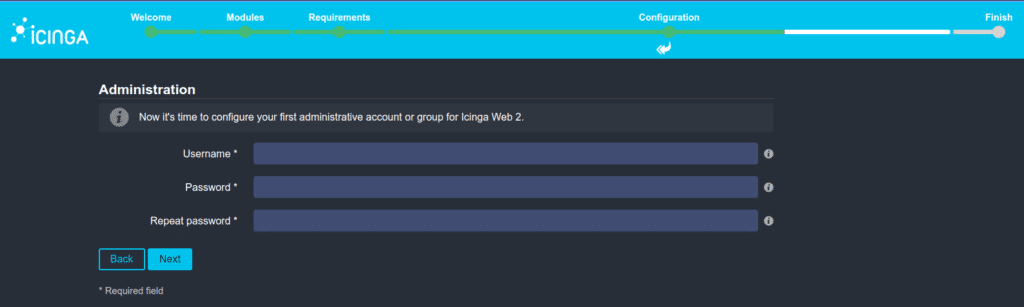

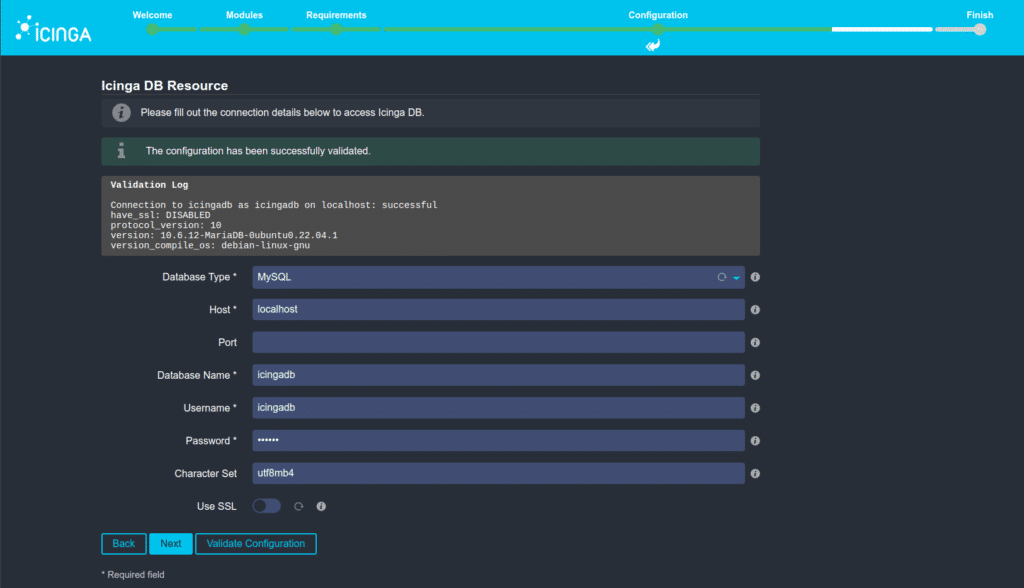

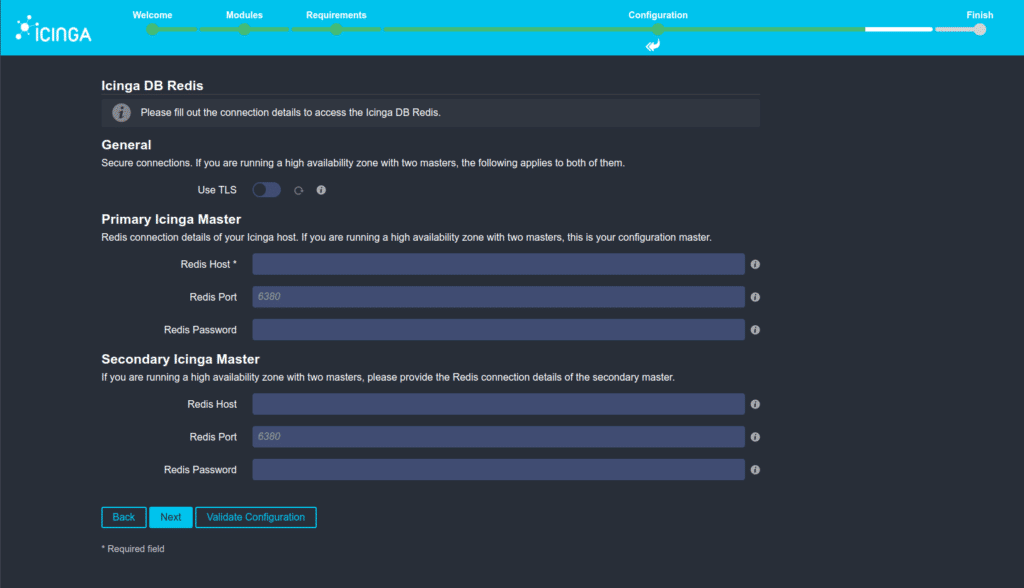

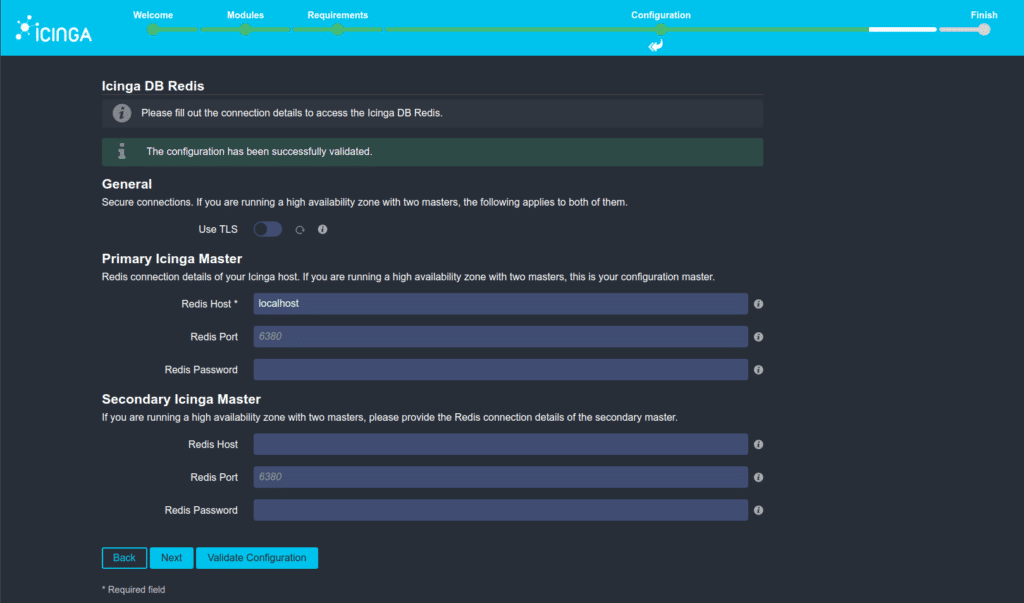

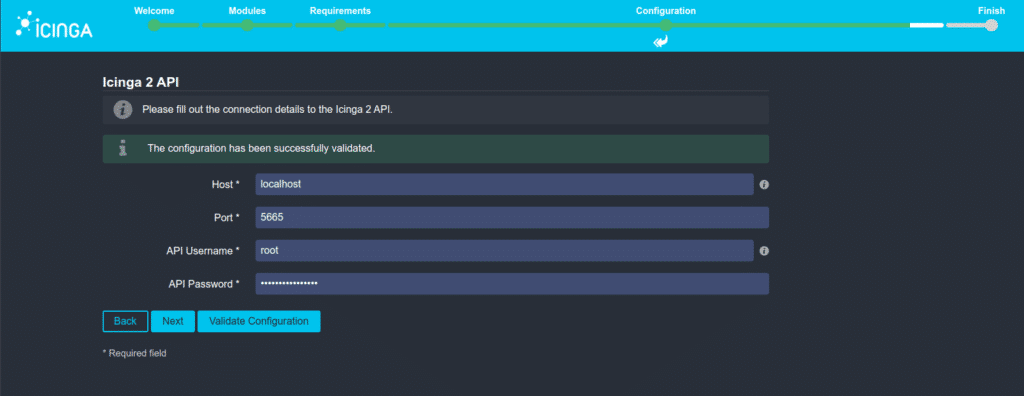

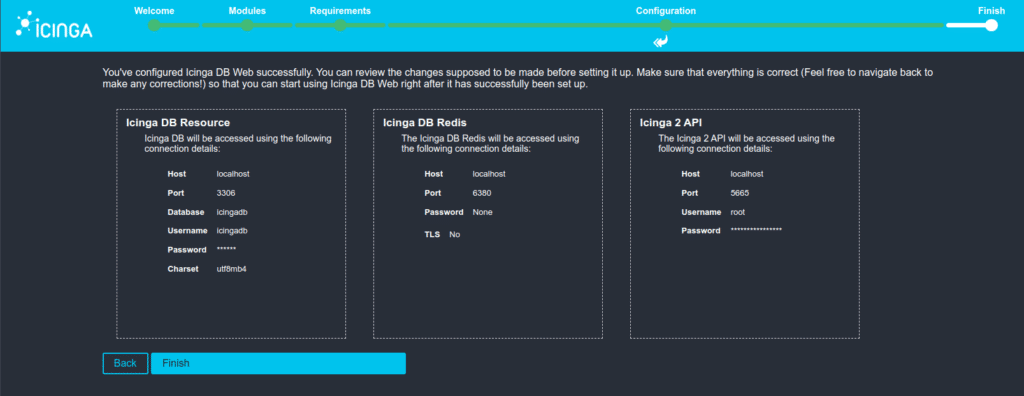

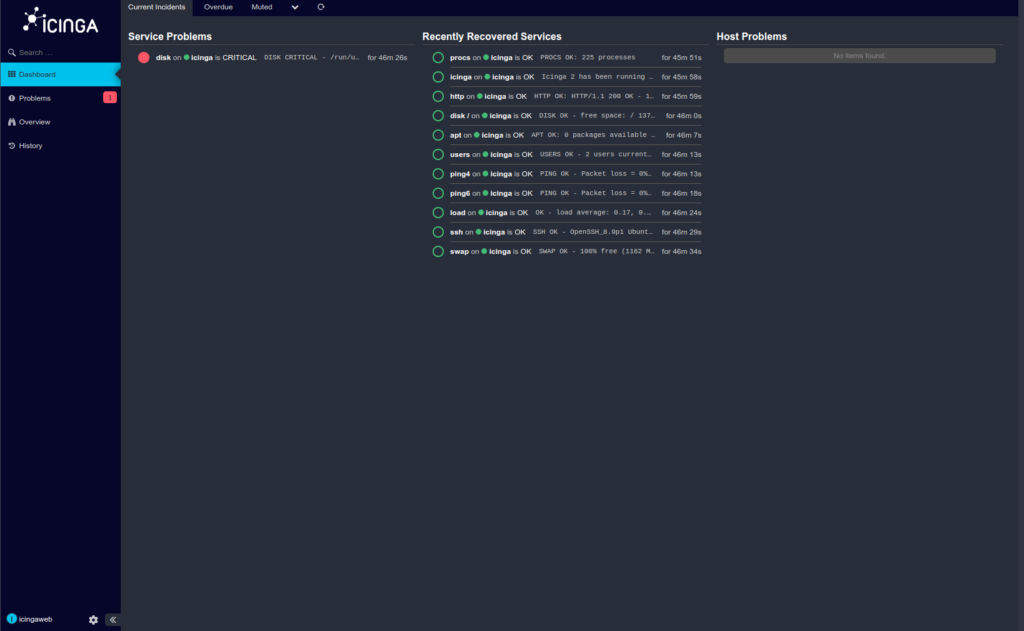

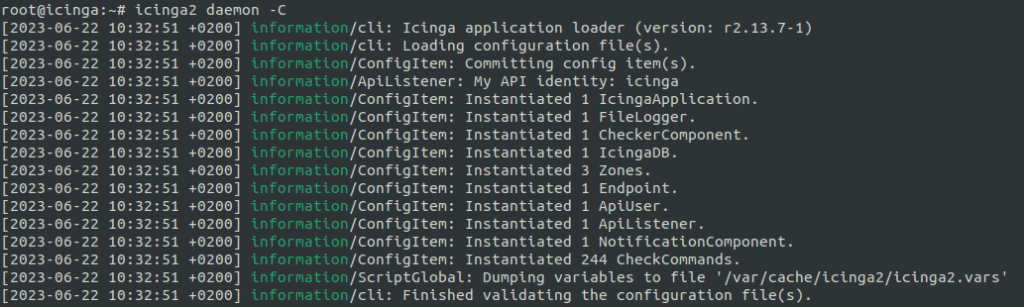

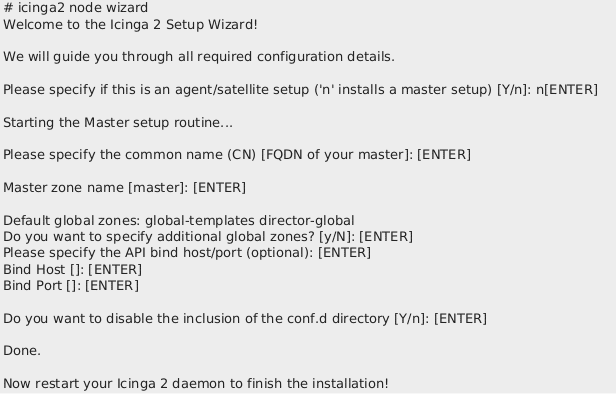

icinga-installer Release v1.2.5

Changelog

- Bugfix: Weitere PHP und Apache Konfiguration wird nun von Puppet verwaltet

- Bugfix: Puppet Daemon auf Debian/Ubuntu deaktiviert

https://github.com/NETWAYS/icinga-installer/releases/tag/v1.2.5