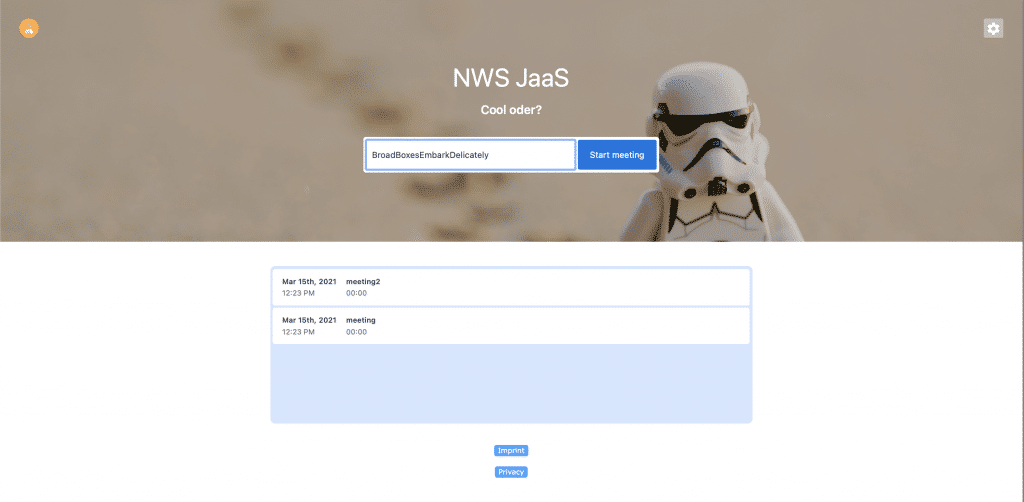

Dein Jitsi as a Service (JaaS) kannst Du jetzt noch besser personalisieren.

Mit Beginn der ersten Coronawelle in Deutschland haben wir die Arbeit an einer Videokonferenz-Plattform begonnen, damals schon auf Basis von Jitsi. Schnell haben wir gemerkt, dass hier viel Bedarf besteht, gerade auch bei kleinen Firmen, Schulen oder Selbsthilfegruppen. Also haben wir die #StayAtHome Kampagne ins Leben gerufen, womit ihr unsere Dienste kostenlos nutzen konntet. Wir freuen uns seitdem über zahlreiche neue Kund*innen und euer wertvolles Feedback!

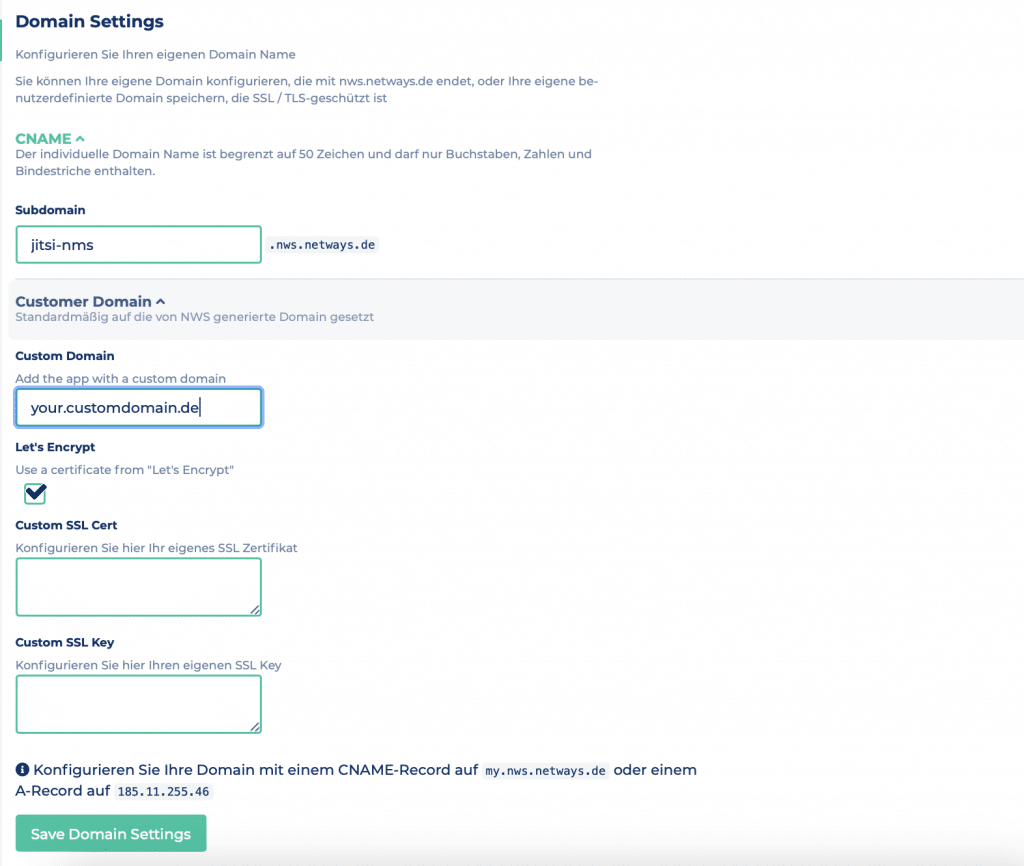

Vor einigen Wochen haben wir uns wieder zusammen gesetzt und versucht, dieses Kundenfeedback zu verarbeiten. Wir haben eure wichtigsten Punkte zusammengeführt und geschaut, wie wir das umsetzen können. Darunter waren Features wie Custom Logos, Logo Links, SIP, Custom Domains. Ein technischer Plan wurde erstellt, ein Zeitplan wurde aufgesetzt und dann ging’s los mit dem Erstellen des Prototypen.

Letzten Freitag war es dann soweit. “Geh ma live, oder was?” – Nun gut. Wir gingen live.

Doch was ist jetzt eigentlich anders? Kurz gesagt: ALLES.

Was ist neu? Ein kleiner Überblick

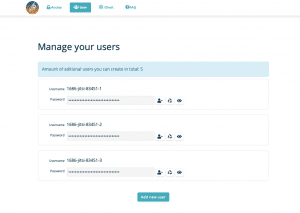

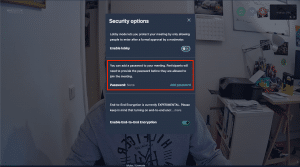

Die Passwort Authentifizierungsmethode haben wir ergänzt durch die JWT Authentifizierung. Du kannst hier Deine bevorzugte Methode zum Erzeugen der Tokens nehmen, oder eben unsere eigene Maske. Du kannst Dich also ab sofort entscheiden, was Du nutzen möchtest. Besonders wichtig ist dies für die Integration in RocketChat oder Mattermost.

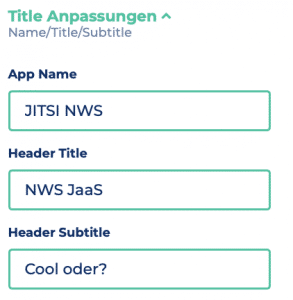

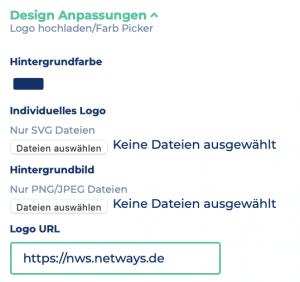

Die auffälligste Neuerung wird aber die Design Sektion sein. Ich mach es kurz. Customizable ist:

- Hintergrundfarbe

- Logo

- Hintergrundbild

- LogoURL

- App Name

- Title

- Subtitle

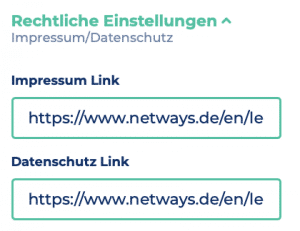

- Impressum Link

- Datenschutz Link

- Cors Domains

Die Bilder, die für die Designänderungen ausgewählt wurden, landen in einem S3 Bucket. Jede Instanz hat einen eigenen Bucket und wir nutzen hier unser hauseigenes S3. Es gehen also wie üblich keine Deiner Daten ins Ausland.

Die Preise bleiben gleich. Du bekommst unser Jitsi für 25 User schon ab 24,99 €. Wichtig ist aber, dass es sich hier nicht um unique-User handelt oder Moderatoren, sondern um parallele User. Das unterscheidet uns von anderen großen Anbietern. Ebenso wie die Tatsache, dass wir alle Features für alle Pakete anbieten – egal, ob Du den kleinsten oder größten Plan gebucht hast.

Schaut’s euch an! Wir haben viel Zeit und Mühe investiert und bieten Dir unser JaaS 30 Tage kostenlos an. Es gibt also keinen Grund, es nicht sofort auszuprobieren. 😉

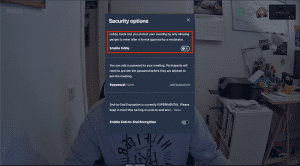

You can enable End2End Encryption at any time. Do you want to secure what is spoken and shown? No problem.

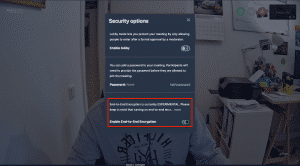

You can enable End2End Encryption at any time. Do you want to secure what is spoken and shown? No problem. Only the participants which are joining your meeting and are activating E2E as well, can see and hear what you are saying. It will secure the data sent to the clients.

Only the participants which are joining your meeting and are activating E2E as well, can see and hear what you are saying. It will secure the data sent to the clients. A common problem with Jitsi was that you could enter an already occupied conference with the same room name. Here is a feature that counteracts this problem.

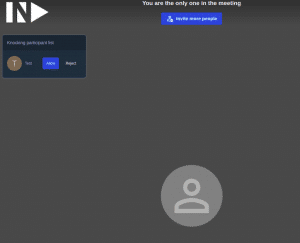

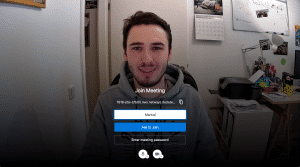

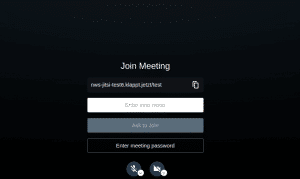

A common problem with Jitsi was that you could enter an already occupied conference with the same room name. Here is a feature that counteracts this problem. Now every participant has to enter his name and ask if he can join the session.

Now every participant has to enter his name and ask if he can join the session. The moderator can then decide whether or not the participant can join the session.

The moderator can then decide whether or not the participant can join the session. Moderators are the only one, which are allowed to enable the communication in a conference room, change security settings, enable E2E or the lobby feature, kick participants and so on.

Moderators are the only one, which are allowed to enable the communication in a conference room, change security settings, enable E2E or the lobby feature, kick participants and so on.

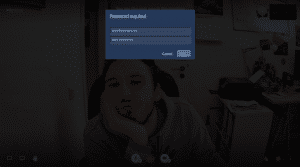

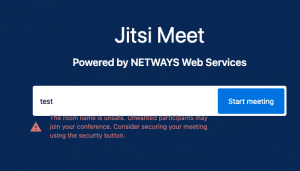

In today’s time of home schooling, it unfortunately brings problems with it. Students who have received the invitation link can guess the name of other classes if the naming convention is the same and can anonymously log in to this class and disturb it.

In today’s time of home schooling, it unfortunately brings problems with it. Students who have received the invitation link can guess the name of other classes if the naming convention is the same and can anonymously log in to this class and disturb it.

If you use names like “test” or “foobar”, it is easy to join your rooms and disturb you and your attendees.

If you use names like “test” or “foobar”, it is easy to join your rooms and disturb you and your attendees. To secure your Jitsi even more, we have another feature ready for you.

To secure your Jitsi even more, we have another feature ready for you.