Die Nutzung von APIs ist in der modernen Softwareentwicklung nicht mehr wegzudenken und ein zentraler Bestandteil einer funktionierenden DevOps-Strategie. Mit einer API können Applikationen, die voneinander unabhängig sind, miteinander arbeiten und Daten austauschen.

Wozu brauche ich APIs?

APIs setzt man immer dann ein, wenn man einen hohen Grad an Automatisierung erreichen und eine dynamische und programmatische Infrastruktur aufbauen und betreiben will.

Was können wir?

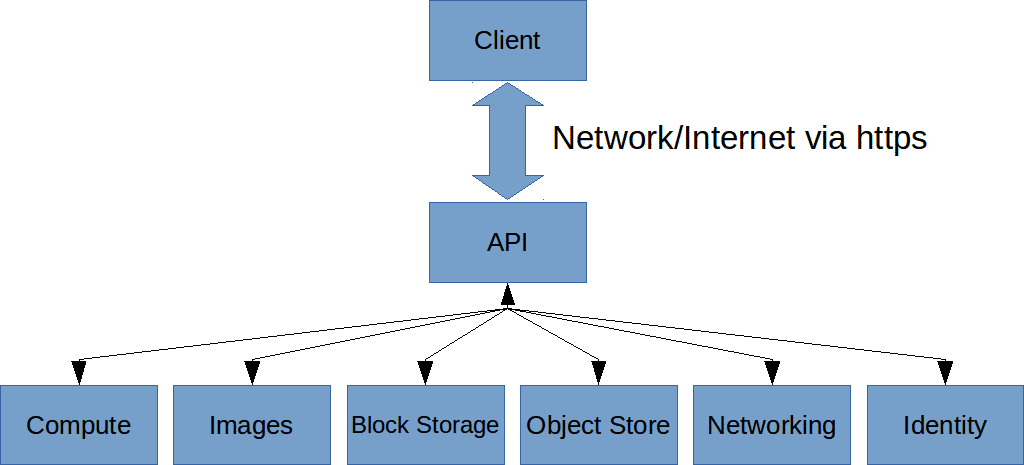

Wir setzen bei unserem Cloud-Angebot auf nws.netways.de auf OpenStack und stellen somit unseren Hostingkunden auch die verfügbaren OpenStack-APIs zur Verfügung. APIs gibt es für alle OpenStack-IaaS-Komponenten in der NETWAYS Cloud: Compute (VMs), Storage (S3, Volumes, Images) und Network (VPNaaS, SDN, Firewall usw.).

Die OpenStack-APIs kannst Du verwenden, um Serverinstanzen zu starten, Images zu erstellen, Instanzen und Images Metadaten zuzuweisen, Speichercontainer und -objekte zu erstellen und andere Aktionen in deiner OpenStack-IaaS Instanz auszuführen.

Zielgruppe

Entwickler, Admins, DevOps und alle, die sich voll auf Ihre Anwendungen konzentrieren wollen.

Wie kann ich loslegen?

Einfach unter nws.netways.de einen Account anlegen und loslegen. Und bei Bedarf steht unser MyEngineer bei jedem Projektschritt mit zur Seite.